HIXのように動作し、AI生成テキストをより自然に聞こえるようにしつつ、基本的なAI検出フィルターを回避するのに役立つ無料のAIヒューマナイザー(人間ぽくする)ツールを探しています。見つけたツールのほとんどは有料か品質が低いか、あるいは明らかなAI特有のパターンが残ってしまい、結局フラグが立てられてしまいます。信頼できる無料オプションをご存じの方や、文章の明瞭さと読みやすさを保ちながらAI検出率を実際に下げられるワークフローや設定などがあれば、ぜひ教えてもらえませんか。

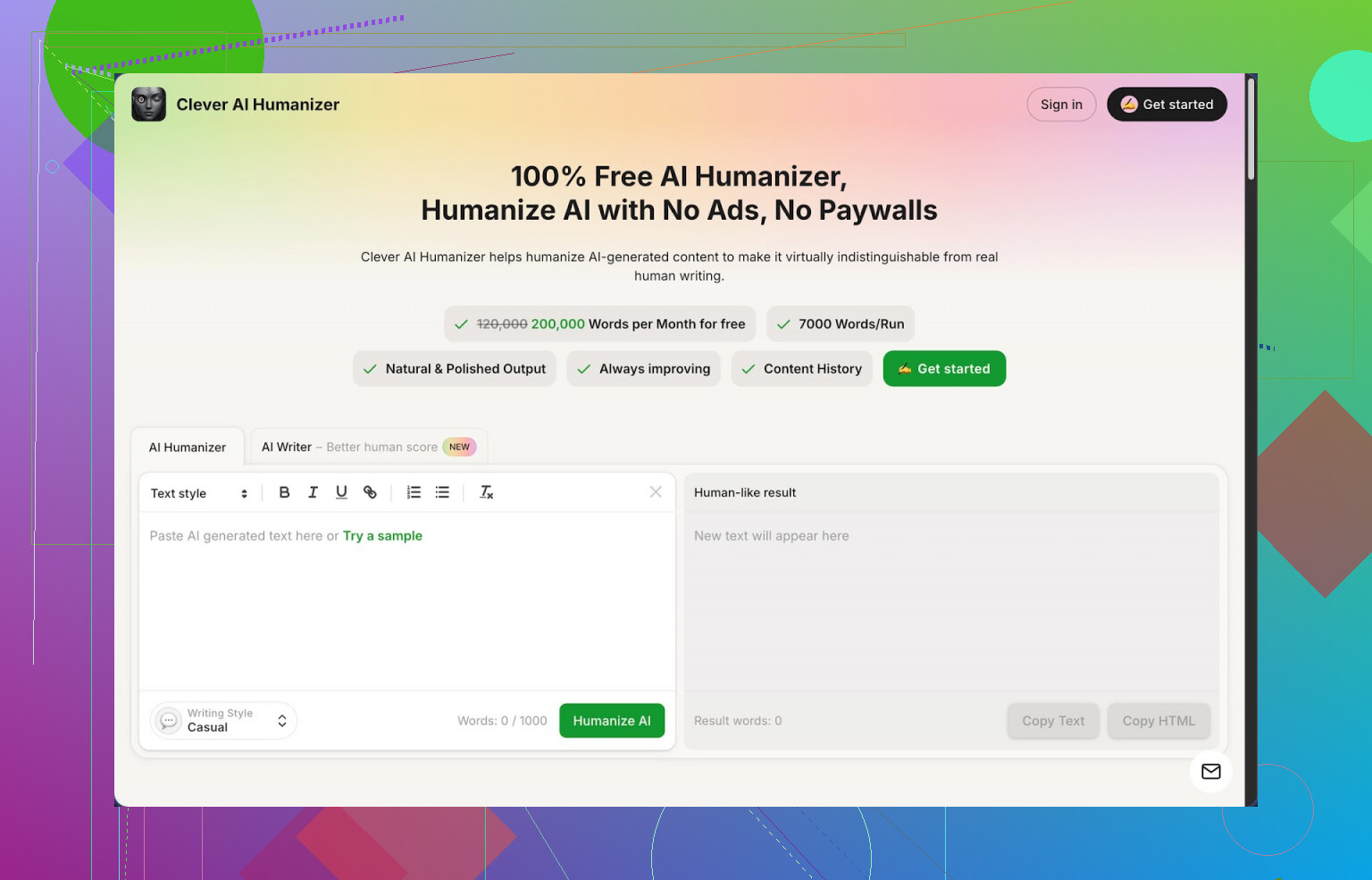

1. Clever AI Humanizer レビュー

毎回テキストを AI 検出ツールにかけるたびに「99% AI」と出るのにうんざりして、Clever AI Humanizer にたどり着きました。自分は AI ツールで文章を書くことが多いのですが、出力がぎこちなくなりがちで、検出ツールにも容赦なく引っかかります。そこでいろいろなヒューマナイザーを試してみて、その中でいちばん長く使い続けたのがこれでした。

メインリンク:

https://cleverhumanizer.ai/jp

最初に惹かれた理由は単純で、無料なうえに上限がかなりゆるいことです。月あたり約 200,000 語、1 回あたり約 7,000 語まで使えて、数段落でいきなり課金の壁が出てくるようなこともありません。自分の用途では、派手なマーケティングよりもこの点のほうがよほど重要です。

用意されている文体は 3 種類です:

- カジュアル

- 簡易アカデミック

- 簡易フォーマル

特別なものではありませんが、たいていの用途には十分対応できます。自分はほとんどカジュアルを使いました。

カジュアル設定で 3 つの別々のサンプルを通し、そのあと ZeroGPT でチェックしました。結果はどれも AI 率 0% でした。これが今後どんな検出ツールでも永遠に通用するかといえば、そこまでは信じていませんが、少なくともその組み合わせでは、その日に試したどのツールよりも良い結果が出ました。

使い方はシンプルです。

Free AI Humanizer に AI が書いたテキストを貼り付けて、スタイルを選び、ボタンを押すだけ。数秒で書き直しバージョンが出てきます。他のツールのように意味をバラバラにせず、やたらと変な文に変換してしまうこともありません。メインの趣旨はきちんと残り、自分が寝ぼけていないときに書きそうな文章にかなり近い読み心地になりました。

また、文字数が増える傾向があります。書き直された文章は、元のテキストより長くなることが多いです。最初はそれが少し気になりましたが、よく考えると、典型的な AI パターンを崩すための一部だとわかりました。字数制限が厳しい場合は、自分で後から削る必要があります。

ヒューマナイザーだけでなく、同じ画面の中にもう 3 つツールがあります。

- Free AI Writer

これはゼロからテキストを生成し、そのあと同じ流れでヒューマナイズできるツールです。短いブログ風の文章で試し、その結果をヒューマナイザーにかけてから検出ツールで再チェックしました。ほかの AI から持ち込んだ文章よりも、こちらのほうが人間らしさのスコアは少し良かったです。おそらく、ここの Writer は自社のヒューマナイザーとうまく噛み合うように調整されているのでしょう。

自分が役立ったと感じた場面:

- 学校の課題風のエッセイ用のざっくりしたアウトライン作成

- いきなりゼロから書きたくないブログの荒い下書き

- FAQ など重要度が高くないページ用の埋め草セクション

- Free Grammar Checker

おまけ程度かなと思っていましたが、意外と悪くありません。対応しているのは:

- スペルミス

- 句読点の誤り

- 基本的な読みやすさの問題

ヒューマナイズ後の文章を通してみたところ、ぎこちない部分や余計なコンマをいくつか拾ってくれました。文体提案の積極性という点では Grammarly ほどではありませんが、「とりあえず壊れて見えなければいい」というレベルなら十分でした。

- Free AI Paraphraser Tool

意味は変えずに言い回しを変えるツールです。自分が助かったケースは次のとおりです:

- SEO 用に、同じ構文ばかり繰り返さないようにセクションを書き換えるとき

- 荒い下書きを、自分の口調に近い文章へ整えたいとき

- ブログ記事から、もう少しアカデミックな文書に寄せたいときのフォーマルさ調整

これも、ときどき文章がふくらみます。なので、仕上がりの分量をシビアに管理したい場合は、最終的に自分で削る必要があります。

まとめると、このサイト 1 つで使える主な機能は 4 つです:

- ヒューマナイザー

- ライター

- 文法チェッカー

- パラフレーズツール

これらを連結して使えるようになっています。自分はよく

別の場所で AI 下書き → Humanizer に貼り付け → Grammar でチェック → 軽く手動編集

という流れで使いました。

別々の会社のツールを 3 つ開いて行き来するより、この方がかなり時間の節約になりました。

もちろん欠点もいくつかあります。

- 検出ツールによっては、いまだに AI 判定が出ます。ZeroGPT 以外の検出ツールもいくつか試しましたが、常に 0% というわけではありません。生の AI 出力よりは確実にマシですが、完全に見破られないわけではないので、「どんな検出ツールでも必ずごまかせる」と期待するとがっかりします。

- 文字数の膨張は現実的な問題です。タイトな 800 語の記事から始めて、フルのヒューマナイズとパラフレーズをかけると、1100 語前後になってしまい、結局削る必要が出てきます。

- 文体コントロールは限定的です。3 種類のプリセットでも十分といえば十分ですが、かなり細かいトーン調整をしたい場合は、自分で手を入れる必要があります。

とはいえ、これだけの機能と月あたり約 200k 語を無料で使えるツールとしては、最終的に一番使い続けることになりました。日常使いという観点では、手間と結果のバランスがちょうどいいところに収まっています。

もっと詳しい内容やスクリーンショット、AI 検出ツールでの検証結果などを見たい場合は、こちらの詳細レビューがあります。

https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

動画レビューはこちら:

他のユーザーの体験と比較するうえで参考になった Reddit スレッドもいくつかあります。

ベストな AI ヒューマナイザーに関するディスカッション:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AI テキストを人間らしくすること全般についての雑談:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=ja/

もしHIXのようなものをお金をかけずに使いたいなら、選択肢はツール、設定、手動修正の3つです。

ツール

@mikeappsreviewer が言っていることにはかなり同意しますが、一つの検出ツールの組み合わせだけを「証拠」として頼るべきではありません。ZeroGPTはAIテキストにも人間のテキストにもよく誤判定します。

とはいえ、Clever Ai Humanizer は無料ツールの中ではまだマシな部類です。あなたのケースでの主な利点は次のとおりです。

- 無料枠でも上限語数が多く、エッセイや長めのブログ記事でも使える

- スタイル(カジュアル、簡易アカデミック、簡易フォーマル)を選べるので、単なる類語置き換えではなく「人間っぽい響き」に寄せやすい

- ツール内のライターで書かせてからヒューマナイザーをかけると精度が上がるが、必須ではない

私の考え

「100パーセント人間」みたいな主張は信じないほうがいいです。ツールは明らかなAIっぽさを減らすために使うのであって、確実な回避を保証するためではありません。

無料のままそこそこの品質を保つシンプルな組み合わせはこんな感じです:

-

まずはどのLLMでもいいので下書きを生成する

- 少し崩れた感じの出力をリクエストする。例えば:

「会話調で書いて。文の長さをばらつかせて。短い文片もいくつか入れて。構成を完璧にしないで。」 - これだけでもAI的な規則性はかなり減ります。

- 少し崩れた感じの出力をリクエストする。例えば:

-

それを Clever Ai Humanizer に通す

- ほとんどの用途ではカジュアルを選ぶ。

- 文字数が増えすぎたら、もう一度LLMに貼り付けてこう指示する:

「現在の7割くらいの長さに短くして。同じ口調を保って。全体を書き換えず、圧縮だけして。」

-

自分で小さな「人間の指紋」を足す

- AIには思いつきにくい、1〜2個のささやかな個人的エピソードや具体例を足す。

- ところどころ、あえて少し不完全な言い回しにする。

- 「in addition」のような汎用フレーズを、自分が普段よく使う言い回しに差し替える。

-

複数の検出ツールでスポットチェックする

- 一つのサイトだけに頼らない。

- どこか一つだけが強く警告して、他がそうでもないなら、「基本的な」フィルター対策としては十分な場合が多いです。

基本的なフィルターを抜けやすくするテキストの習慣

- 長文と短文を混ぜる。

- 「you’re, I’m, doesn’t」のような短縮形を使う。

- 自分が普段使う弱め表現を入れる(文脈が許せば「sort of, kinda, tbh, ngl」など)。

- 「Firstly, Secondly, Thirdly」や「In summary」のような繰り返し構造は避ける。

避けたほうがいいこと

- 類語置き換えだけをする「AI humanizer」系サイト。そういうものは検出ツールにかなり引っかかります。

- いじりすぎて、逆にまた没個性的な文章に戻してしまうこと。検出ツールが見ているのは品質ではなくパターンです。

最初のプロンプトを少し崩したものにして、Clever Ai Humanizer を一度通し、その後に人間の手でざっと仕上げれば、十分自然に聞こえて、基本的・いい加減なAIチェックならたいてい通る文章になります。

短く言うと「魔法の“無料版HIX”みたいなもの」があって、どんな検出器にも完全にバレない……というのはまず無理です。ただし、ツールの組み合わせと文章の作り方を工夫すれば、基本的なフィルターならかなり近いところまでは行けます。

@mikeappsreviewer と @techchizkid が Clever Ai Humanizer についてはすでにけっこう詳しく説明しているので、同じ手順をなぞるつもりはありません。ここでは「どこにハマるか」と「その上に何を重ねるか」だけ補足します。

1. ツール選び(無料で、しかもゴミじゃないもの)

HIX に近いものを無料で求めるなら、正直なところ Clever Ai Humanizer だけが、いわゆる「AIヒューマナイザー」の中でまだマシです。ほかはだいたいどちらかです:

- ひたすら類語に置き換えただけのサラダ文

- 200語くらいで「続きは有料」のティーザーだけ見せてくる壁

無料枠とスタイル指定の組み合わせで、こんな用途には十分使えます:

- 「普通の人が書いたっぽく」仕上げたいエッセイ

- いかにもチャットボット風にはしたくないブログ記事

@techchizkid が提案していたように、Clever Ai Humanizer の内蔵ライターだけに頼るのにはあまり賛成できません。自分のテストでは、別のLLMでまず書かせてから Clever Ai Humanizer をかけたほうがバリエーションが増え、そのぶん検出器には有利に働きました。彼らのやり方も悪くはないですが、それだけが正解というわけでもありません。

2. 生成の仕方は、多くの人が思っている以上に重要

よくあるのが、こんな指示です:

「Xについて1000語の記事を書いて。フォーマルな文体で、見出しを構造化して、最後に結論も。」

そして検出器に「AIです」と叫ばれて慌てる、というパターン。でもこれは当然です。いかにも機械っぽいスタイルをそのまま指定しているので。

代わりにこんなプロンプトを試してください:

- 「友達に説明する感じで書いて。ちょっと雑でもいい。短い文と、少し長くてダラダラした文を混ぜて。箇条書きは、本当に必要なとき以外はあまり使わないで。」

- 「その分野には詳しいけど、ちょっと疲れた大学生みたいな口調で。きれいすぎる文にはしないで。」

これだけでも、ヒューマナイズ前の段階で、簡易なAI検出のスコアがかなり落ちることがあります。

3. Clever Ai Humanizer が本当に効くのはどこか

これは「魔法の消しゴム」ではなく、あくまでパターンを崩すための道具として使います:

- まず、LLMで下書きを作る(上のような「少し崩した」プロンプトを使う)

- それを Clever Ai Humanizer に一回だけ通し、自分のしゃべり方に近いスタイルを選ぶ

- ヒューマナイザー → パラフレーズ → ヒューマナイザー…と何度も重ねない

- そうすると、やたら長くて中身が薄い、妙に一般論ばかりの文章になりがちです

@mikeappsreviewer は語数が膨らむ点にわりと寛容な印象ですが、語数上限がシビアな課題(レポートや出願書類など)ではここは普通に致命的です。自分はだいたい:

- まずヒューマナイズ

- そのあと自分で2〜3割くらい削る

という手順にします。「短くして」と別のAIに頼むと、またあの「いかにもAI」なリズムが戻ってきてしまうことが多いからです。

4. ほんの少しだけ「人間ぽいノイズ」を足す

検出器は語彙だけでなく、構造や均質さも見ています。

崩しすぎずに効く、小さめの調整としては:

- 長めの文をいくつか、あえて途中で切って断片にする:

- 「それが…正直あまり良くない。」みたいな感じ

- AIではまず出てこない、自分の生活や状況に即した具体例を1〜2個だけ入れる

- 自分なら絶対に使わないつなぎ言葉を、少しだけ自分らしい表現に変える

- 「さらに、加えて、したがって」みたいなのを

「あと、それに、だから」みたいな口調に変える

- 「さらに、加えて、したがって」みたいなのを

ただしスラングを盛りすぎると、今度は別の意味で不自然になるので控えめに。

5. 検出器と「バイパス」の現実

大学や企業などの、かなり厳しめに調整された検出器を完全に抜けたいなら、どんなヒューマナイザーでも保証はできません。そういうシステムは、そもそも「やたら構造が整った、整理されすぎた文章」そのものを疑うようになっています。

実務的なポイントとしては:

- 検出器は1つだけでなく、2〜3種類は試す

- 1つだけが強烈に「AI」と出て、残りが控えめ〜グレーなら、基本的なフィルターは通る可能性が高い

- どれも「90〜100%AI」と出るなら、その原稿は捨てて、最初からプロンプトを変えて「崩した文体」で書き直したほうが早い

6. ヒューマナイザー自体が間違った選択のとき

あまり言われたがりませんが、状況によっては次のほうが圧倒的に安全です:

- アイデア出しやアウトライン作成だけAIに任せる

- 本文は自分で、アウトラインに沿って書く

- そのあとで、AIには「文法とわかりやすさのチェック」だけさせる

特に重要度が高いものほど、このやり方のほうが、どんな「HIXクローン」戦略よりも堅実です。

まとめると、無料でHIXっぽいことをやりたいなら、現時点では Clever Ai Humanizer が一番マシな選択肢ではあります。ただしそれが効くのは、

- プロンプト設計で最初から「きれいすぎない文章」を作る

- その上で1回だけ、パターン崩しとして使う

- 仕上げに自分の手で少し編集して、「自分の声」を混ぜる

というセットで動かしたときだけで、「検出器が数学を忘れてしまう透明マント」みたいな代物ではありません。